Riflessioni collettive dalla Sessione di Sensibilizzazione a Rovigo (Padova)

Di Juliana Raffaghelli, Francesca Crudele, Martina Zanchin

🇬🇧 English version: read here

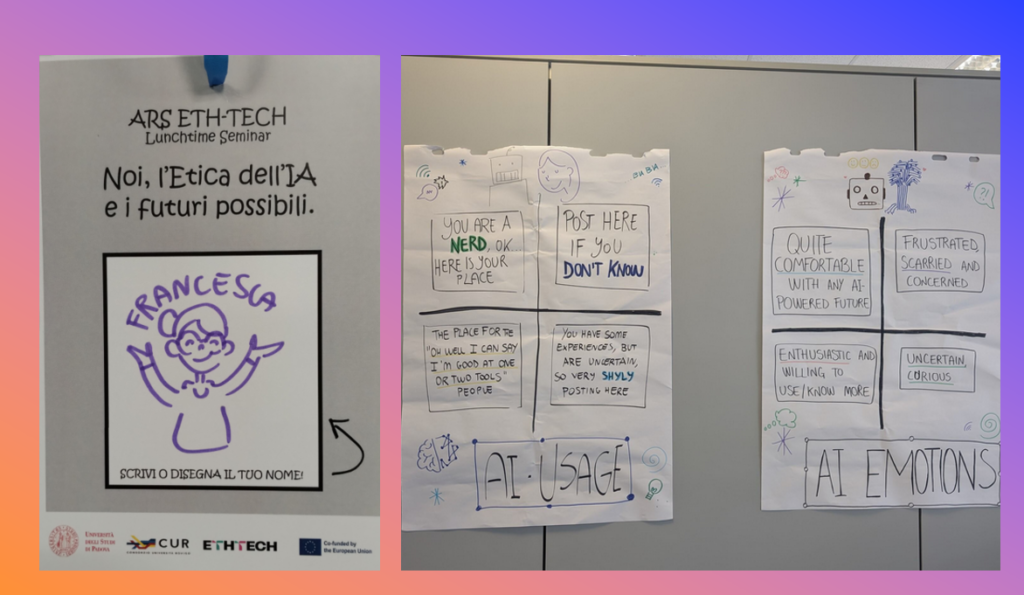

Gli “ARS” o “Awareness Raising Sessions” (Sessioni di Sensibilizzazione) sono parte di una strategia partecipativa per focalizzare gli aspetti dell’Etica dell’IA che poi diventeranno un elemento chiave delle Risorse Educative Aperte dentro il nostro progetto (cfr. Attività)

In questo post ti raccontiamo com’è andata la sessione svolta nella nostra sede universitaria UNIPD di Rovigo, che ci ha dato una splendida ospitalità!

Abbiamo dato forma al nostro incontro come un “Seminario con Pranzo al Sacco” [Lunchtime Seminar]: condividere il pranzo e condividere idee, per nutrirci 😉

La sede infatti è stata scelta proprio in virtù della presenza di corsi universitari dove ci sono potenziali formatori, da Scienze Infermieristiche, Scienze dell’Educazione (Educatore per la Prima Infanzia) a Management dei Servizi Educativi e del Lifelong Learning.

Ecco il nostro racconto!

Panoramica della Sessione

La sessione è iniziata con i partecipanti che lavoravano in piccoli gruppi su dilemmi etici fittizi ma realistici relativi all’uso dell’IA nell’istruzione. Nonostante fossero stati offerti dieci casi diversi – che spaziavano dall’uso domestico di Alexa, alla sorveglianza scolastica, alla governance istituzionale – più gruppi hanno casualmente selezionato lo stesso: una classe universitaria di informatica in cui gli studenti utilizzavano l’IA in modo collaborativo, senza resistenza o guida da parte del loro professore. Il caso ha suscitato un immediato riconoscimento e identificazione.

“Abbiamo effettivamente scoperto di vivere una situazione simile,” ha condiviso un partecipante. “Come studenti, quando ci vengono assegnati compiti di gruppo, ci organizziamo, usiamo l’IA, perché è disponibile. Quindi la usi.”

Ciò che è iniziato come una riflessione su un singolo esempio in classe si è presto trasformato in un’indagine collettiva più ampia su cosa significhi insegnare, imparare e agire eticamente in istituzioni sempre più digitalizzate e datificate.

“È come una simulazione”: Insegnamento e Apprendimento in Pilota Automatico

Al centro del caso c’era una sensazione di disconnessione – tra studenti e insegnanti, tra intenzioni e azioni. Un partecipante ha descritto la dinamica in termini crudi:

“L’insegnante era letteralmente indifferente. Non gli importava che gli studenti usassero l’IA e non pensassero criticamente da soli… Voleva solo assicurarsi il posto di lavoro.”

La situazione risuonava ampiamente. Un altro partecipante ha offerto una metafora inquietante:

“È come una simulazione dell’ambiente educativo. Gli studenti simulano l’apprendimento e l’insegnante simula l’insegnamento. Tutti stanno solo recitando.”

Questa idea di “simulazione” echeggiava la critica di Gert Biesta (2023) all’educazione performativa: sistemi guidati più dall’apparenza e dalla conformità che dallo scopo e dal significato. La passività dell’insegnante, abbinata al pragmatismo tattico degli studenti, ha esposto come l’IA venisse silenziosamente normalizzata – non come oggetto di indagine, ma come strumento di sfondo in una più ampia performance educativa.

“Ti senti in colpa, ma la usi comunque”: Ambivalenza Emotiva e Deriva Etica

La conversazione si è spostata sul terreno emotivo della questione – cosa si prova a usare l’IA in questi spazi ambigui. Uno studente partecipante ha riflettuto:

“Abbiamo parlato di emozioni – sentimenti di colpa, delusione, amarezza… quella parola italiana amarezza. Sai che non è proprio giusto usarla, ma lo fai comunque.”

Altri hanno parlato del peso emotivo che gli insegnanti portano:

“Sono sopraffatti. C’è il programma da seguire, le aspettative della società, le scadenze istituzionali… e forse anche questa paura di essere sostituiti dall’IA.”

Tali riflessioni hanno rivelato una profonda complessità emotiva: studenti intrappolati tra capacità e coscienza; insegnanti divisi tra cura ed esaurimento. La sessione ha chiarito che l’etica dell’IA non riguarda solo principi astratti – è saturata di affetto, ansia e compromessi taciti.

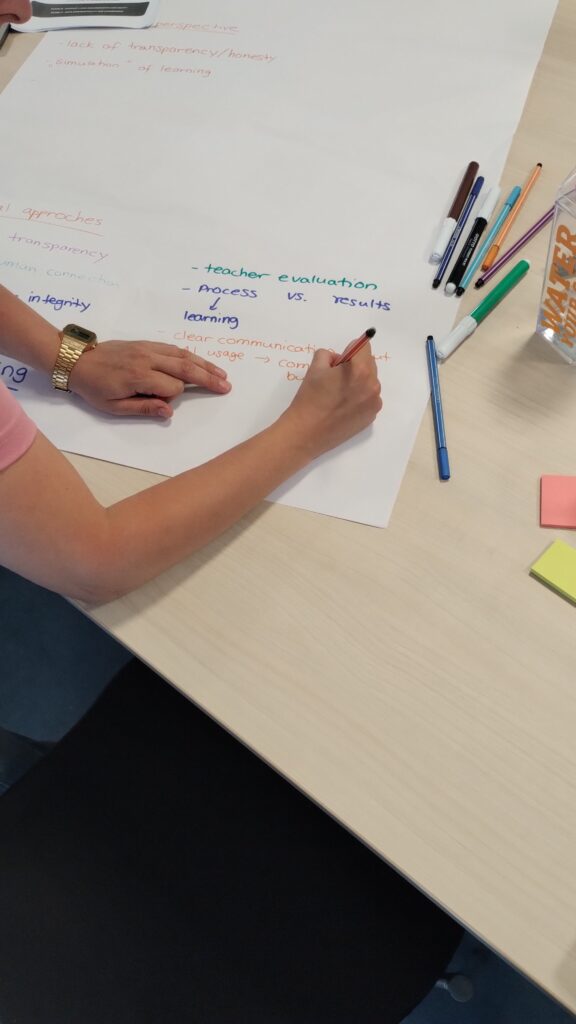

“Dobbiamo formare sia gli studenti che gli insegnanti”: L’Etica come Pratica, Non come Politica

I partecipanti sono converguti su un’intuizione pratica: l’uso etico dell’IA deve essere insegnato – ma non solo in senso tecnico.

“Non si tratta solo di sapere come usarla. Si tratta di come pensare con essa, o non pensare con essa. È qui che entra in gioco la formazione critica.”

Un altro ha aggiunto:

“La valutazione è un grande problema. Se non ripensiamo la valutazione, continueremo a premiare il successo superficiale.”

Questo ha portato a un’esplorazione di come i sistemi educativi – attraverso strutture di voto, carichi di lavoro e modelli di finanziamento – modellino ciò che viene insegnato, ciò che viene valorizzato e ciò che viene ignorato. L’etica, in questa formulazione, non poteva essere ridotta a un modulo o a una casella da spuntare. Doveva essere incorporata nella pedagogia, nelle relazioni e nelle culture istituzionali.

“Non possiamo mettere tutto sulle spalle dell’utente”: Supererogazione e Responsabilità Sistemica

La facilitatrice ha introdotto il termine filosofico “supererogazione morale” per descrivere ciò intorno a cui molti partecipanti stavano girando:

“Stiamo chiedendo agli insegnanti e agli studenti di essere etici… mentre non offriamo loro alternative reali. Non è giusto. Non puoi essere un eroe in un sistema rotto.”

Un partecipante ha illustrato perfettamente questa tensione:

“Non uso Facebook da dieci anni. Non uso WhatsApp. Ma quando sono arrivato qui, l’istruttore ha detto che il gruppo è su WhatsApp. Cosa dovrei fare – rinunciare e sembrare un piantagrane? Ho preso un secondo telefono, solo per adattarmi.”

Queste riflessioni hanno chiarito che le scelte etiche raramente vengono fatte nel vuoto. Vengono fatte in ambienti vincolati, spesso modellati da piattaforme predefinite, pressione dei pari e mancanza di supporto istituzionale. La discussione ha evidenziato la necessità di accordi collettivi, infrastrutture alternative e responsabilità condivisa.

“WhatsApp è facile – ma a quale costo?”: Piattaforme, Infrastrutture e Sovranità

Il gruppo ha iniziato a interrogare le tecnologie stesse. Perché certi strumenti sono usati così diffusamente nell’istruzione? E quali sono le implicazioni?

“Abbiamo parlato di WhatsApp. Fa parte di Meta. E Meta ti spinge a usarlo – è facile, ma non sai cosa comporta usarlo.”

La facilitatrice ha ampliato:

“L’etica non riguarda solo il lato umano. Riguarda l’ecosistema – chi costruisce gli strumenti, chi possiede i dati, dove sono i server. Non possiamo separare l’uso dall’infrastruttura.”

Questo ha aperto una conversazione sulla sovranità digitale. Un partecipante ha chiesto:

“Lucrezia è fantastica – ma è solo per i docenti. Perché gli studenti non hanno accesso? E cosa succede quando ogni università costruisce la propria IA e infrastruttura server? Chi controlla questo?”

Il dibattito etico è diventato geopolitico: politiche energetiche, hosting dei dati, piattaforme pubbliche vs private. I confini tra etica educativa ed economia politica si sono sfumati – intenzionalmente.

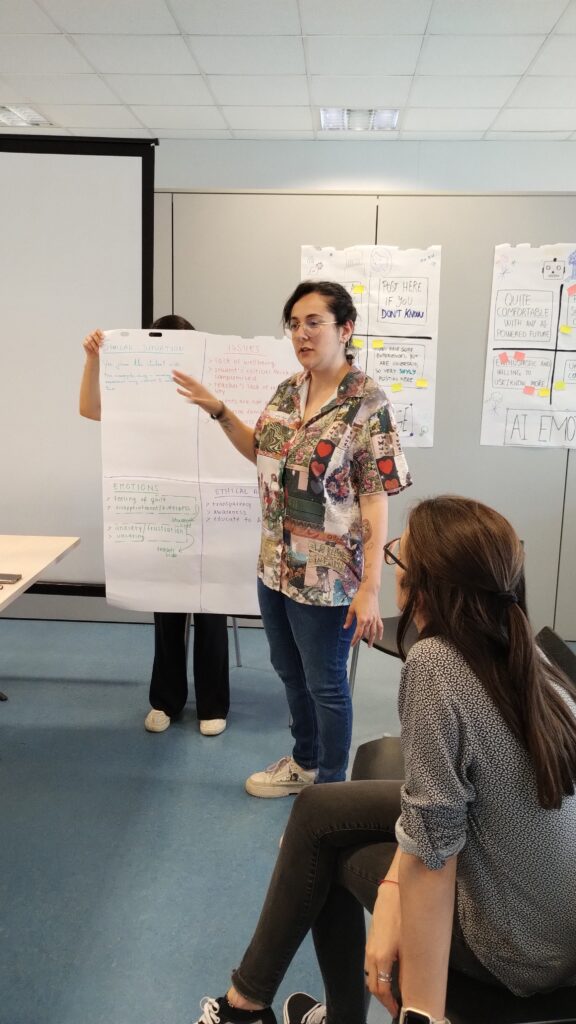

“Non ci sono liste di controllo per questo”: L’Etica come Indagine Critica e Immaginazione

La sessione si è chiusa con un appello a ripensare l’etica stessa – non come una dottrina fissa, ma come un processo:

“L’etica non è una lista di controllo. È continua. Si tratta di chiedere, decidere, immaginare… insieme.”

I partecipanti hanno parlato di costruire accordi co-progettati con gli studenti, incorporando l’etica nel curriculum non come sorveglianza, ma come dialogo.

“Potremmo avere un contratto all’inizio del corso,” ha suggerito un educatore, “dove decidiamo con gli studenti quali strumenti useremo e come.”

La facilitatrice ha fatto eco a questa direzione:

“Siamo in un’era postdigitale. Piattaformizzazione, datificazione e ora IA – non sono neutrali. Ma possiamo rispondere – non solo resistendo, ma immaginando futuri diversi.”

Mentre i partecipanti facevano i bagagli, la conversazione persisteva – sulla cura, sul potere, sui futuri possibili nell’educazione e la formazione. Qualcuno ha scherzato sul non aver aperto il vino Prosecco, offerto come parte del pranzo al sacco.

Invece, era la riflessione sull’etica dell’IA e i dati ad essere stata “stappata.”

Leave a Reply